行動するAIがやってきた!メ環研はCES2026をどう見たか?【中編】

前編で述べたように、「AI Everywhere」にくわえて、「AI for Everyone」や「AI Everything」という言葉も目についたCES2026。

AIはもはやそれ単体を語るべき『新機能』ではなく、空気のようにどこにでも存在し(Everywhere)、誰もがその恩恵を享受でき(Everyone)、24時間意識せずとも(Everytime)、あらゆるモノを通じて人を支える(Everything)インフラへと昇華しつつある様子が見えてきた。では、未来においてAIはどのように生活に浸透し、生活者を支えていくのだろうか。その「実装」のあり方をここから考えていきたい。会場の展示から浮かび上がったのは、AIが「判断」や「提案」を担うだけでなく、現実世界における「行動」そのものを引き受け始めているという明確な変化だった。

■ロボットが家事や産業の「現場労働」担う時代へ

CES2026で来場者の視線を釘付けにしたのは、人のような形をした「ヒューマノイド」ロボットの存在だ。ボクシングのスパーリングや複雑なダンスを披露するデモは即座に拡散され、ロボットの身体制御が一段階上がったことを印象づけた。

だが、より興味深いのはエンタメとしての見せ物ではなく、「生活の労働」を担う方向への進化である。韓国の大手家電メーカーLGが提示したホームロボットのコンセプトモデル「LG CLOiD(クロイド)」は、家庭内で繰り返される家事タスクを、AIヒューマノイドと家電が連携して実行する未来像を示していた。プレスカンファレンスでは、従来から掲げる「ゼロ労働ホーム(Zero Labor Home)」を家庭で実現する存在として、CLOiDが移動しながら複数の作業を自律的にこなす様子が提示された。

ユーザーを先回りして、調理、洗濯、見守りを代行する

さらにLGブースで披露されたデモは、ヒューマノイドが家電・空間・人をつなぎ、生活の段取りそのものを代行する未来を示すものだった。車輪走行で滑らかに移動し、上半身に多関節アームと指を備えたCLOiDは、ただ「動く」だけではない。「家電製品と空間、そしてあなたをシームレスにつなぎ、真に有意義な一日を創り出す仲間(コンパニオン)」として設計されている、という説明が印象に残る。

「献立の提案」から「仕上がりの管理」までこなすヒューマノイド

まずデモンストレーションされたのは、共働き家庭の朝の風景だった。驚くべきは、CLOiDが指示待ちではなく、家族のスケジュールや好みを前提に動く点である。冷蔵庫内のカメラで在庫を確認し、その日の朝食メニューを提案する。冷蔵庫に近づくと扉が自動で開き、アームで牛乳パックを取り出してテーブルに置く。さらにオーブンの予熱から、クロワッサンの焼き色の監視、仕上がりの通知までを一気通貫でこなす流れが示された。

「献立を考える」「食材を出す」「焼き加減を気にする」といった小さな判断と手間を、ロボットが行うのだ。

独自の学習モデルが実現する「仕分け」と「畳み」

続くシーンは、一人暮らしのビジネスパーソンの帰宅に合わせた家事代行だ。ここで語られたのが、 Language Action Learning(視覚言語アクション学習)」という考え方である。CLOiDは洗濯カゴの衣類を視覚的に判別し、色や素材の違いを踏まえて仕分けし、乾燥後のタオルを畳む。柔らかい布を扱う動作は、従来ロボットが苦手としてきた領域だ。また、洗濯機の近くにあらわれたロボット掃除機が進めない状況が起きると、CLOiDがそれを察知して洗濯カゴを移動し、家全体のタスクを円滑に整える。家庭内の家電デバイス同士がAIによって連携し「家の仕事」を最適化する、という方向性が示されていた。

これまでもCESには家庭用ロボットは登場してきたが、「見守り」や「ペット」に近い存在が多かった。今回は、冷蔵庫から食材を判断して取り出し、調理の進行を見守り、洗濯物を仕分け、畳むといった「物理的な家事労働」を引き受ける可能性が、コンセプトとしてはっきり示されたのである。もちろん多様な家庭環境で自在に動くには学習と進歩が必要だろう。それでも、前年と比べて「ロボットのできること」が増え、具体的に家の中で働く様子が見られたことは大きな変化だ。今後5年程度で、家庭にロボットが入り始める、と言われてもおかしくない進化のスピードが感じられた。

急速に進化する産業用ロボット

CES2026では、産業分野におけるヒューマノイドの導入ロードマップも示された。その象徴が、現代自動車グループ(HyundAI Motor Group)の発表である。グループ傘下のBoston Dynamicsが開発するヒューマノイド「Atlas(アトラス)」の新型モデルを公開し、生産現場での活用計画を語った。

HyundAIによれば、Atlasは2028年ごろから米国ジョージア州の生産拠点「Metaplant America」に段階的に導入される計画だという。想定されるのは、部品の取り出しや配置、組み立ての補助など、毎日繰り返される負担の大きい作業である。展示では、人に近い動きに加え、人間には難しい上半身を180度回転させるなどの体の使い方も示され、産業用途としての「実装」が視野に入っていることがわかる。

工場で求められるのは、確実な動作、長時間稼働、予測不能な状況への対応力だ。そこで磨かれる認識・判断・動作の統合技術は、家庭内での家事にも転用されうる。家庭と産業は「現実世界を認識し、身体を動かし、仕事をする」という点では共通する。そこからも、ヒューマノイドが生活に入ってくる未来は遠くないことを予感させられた。

■日常の疑問、記録、外国語翻訳にAIスマートグラスが応える

さらにCES2026で大きく進歩したものの一つが「スマートグラス」だ。従来も展示はあったが、日常装着には大きく重く、実用を阻む要素が多かった。今回は見た目も通常のメガネに近づき、軽量で、AIと常時接続されることで日常的に使いやすく、使う理由があるツールへと進化した。

49gという軽量AIグラスが日常を支える「Rokid Glasses」

その中で人だかりを作っていたのが、ARグラスのパイオニアであるRokid(ロキッド)だ。筆者は25年秋に発売された「Rokid Glasses」を体験したが、まず驚いたのは軽さである。重量は49g。装着感は一般的な度付きメガネに近い。

言葉の壁が消滅する翻訳体験

ブースで翻訳機能を試してみた。

スタッフが早口の英語で説明を始めると、レンズ内側の視界下部に字幕のように日本語訳が浮かび上がる。特筆すべきは遅延の少なさだ。クラウド処理に加え、グラス側の処理も組み合わせることで、相手が話し終わるのとほぼ同時にテキストが追いつく。筆者はCES2025でもRokidで翻訳を体験したが、速度と文字の見えやすさはかなり実用に近づいたと感じた。

翻訳以外にも、視界に矢印で曲がる方向が出るARナビゲーション、目に入った外国語テキストの翻訳、カメラで撮影して内容をAIに質問するといった使い方が想定されている。

連続使用時間は翻訳などのAI機能、オーディオやカメラの断続的な使用(日常的な利用頻度)で8〜10時間という説明だった。

さらにRokidはCES2026に合わせて「Rokid Glasses Style」(39.5g)も発表した。こちらはディスプレイを持たず、音声で案内し、情報表示はスマホ側で行う。連続使用時間は日常使用で12時間を想定しているという。

■日常会話の記録機器で始まる「記憶の外部化」

スマートグラスと並んで目立ったのが、私たちの「記憶」を補完するデバイス群だ。会議の文字起こしや要約は以前からあったが、今回は「一日のさまざまな局面」で必要に応じて気軽に記録する方向へと形が多様化していた。

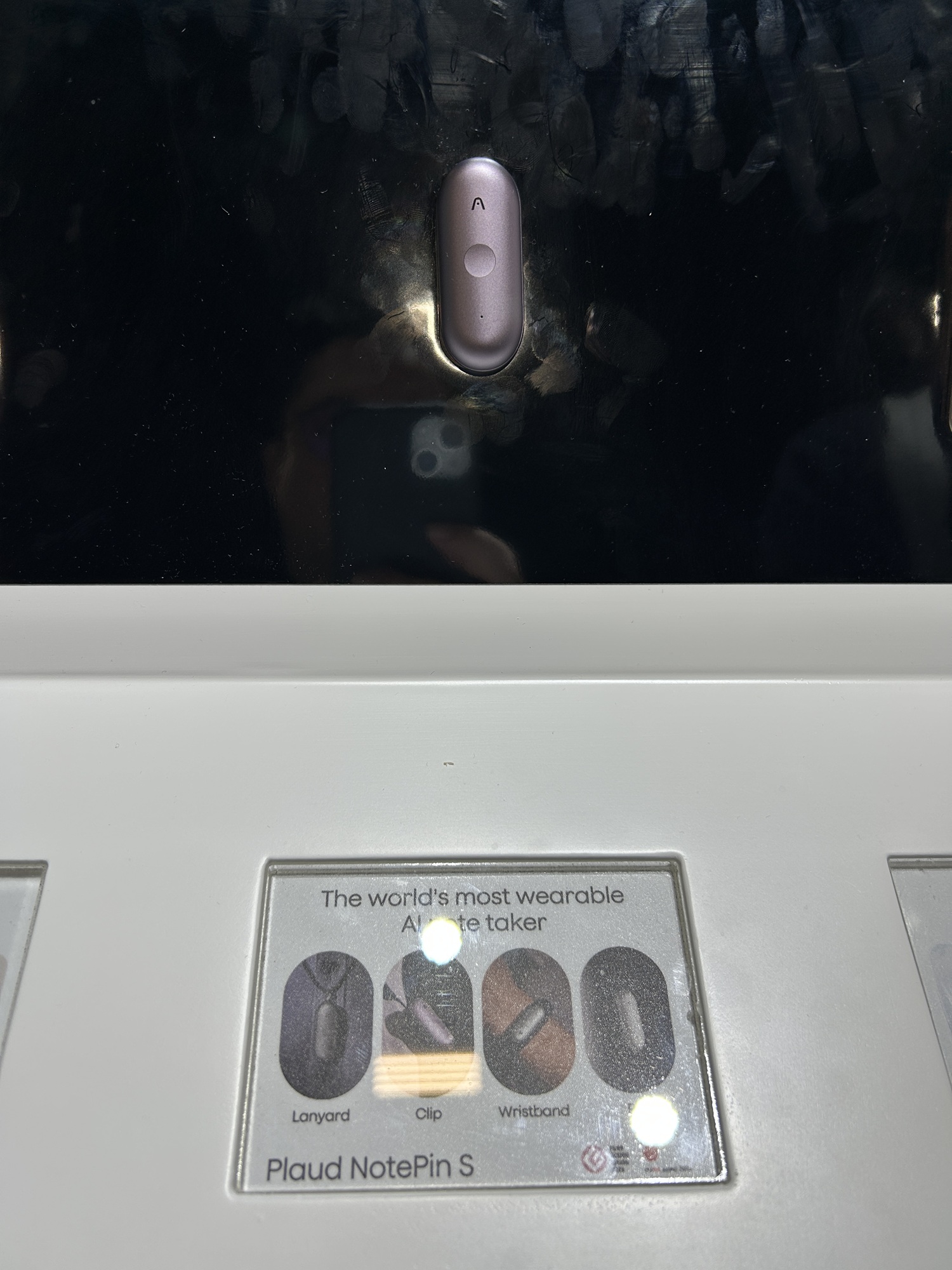

特に「仕事における脳の拡張」という文脈で注目されていたのがPlaud(プラウド)社のウェアラブル「NotePin S」だ。約17gのカプセル型で、襟元に留めたり首から下げたり、腕に巻いたりと、“ピン”のように身につけられる。

進化として語られていたのは操作性である。

必要な時にボタン長押しで録音を開始し、会話の途中で短く押せば「ここは重要」という合図として扱える。後からAIが録音の中から要点を抽出し、要約やアクションリストを作ることもできる。会話が必要な範囲で蓄積され、情報量が多かったとしてもAIにより活用されやすくなっている。多くの情報を扱う仕事においてこの実装の利便性は大きいだろう。

■「デジタルツイン」へと進化するパーソナルAI

さらにLenovoのキーノートで会場を驚かせたのが、傘下モトローラ社のコンセプトデバイス「Project Maxwell」だ。ネックレスやピンのように身につけるウェアラブルな「AIコンパニオン」の試作機(PoC)で、超小型カメラとマイクがユーザーの視覚・聴覚を共有することが想定されている。ステージでは、状況を理解したAIがスマホ操作を挟まず「今日あったことをSNSにアップする文章にしましょうか?」と語りかけるなど、先回りして提案する様子が披露された。

そしてMaxwellを含むレノボ製デバイスを横断する共通の知能として発表されたのが、パーソナルAIスーパーエージェント「Lenovo Qira」だ。印象的だったのは、Qiraが様々なデバイスで見聞きした情報を蓄積することで、デジタル上に自分を理解した分身「パーソナルAIツイン」を構築できる可能性が語られた点である。

PC、スマートフォン、ウェアラブルなどの様々なデバイスを横断して行動や会話を学習することで、AIは単なる道具を超え、忘れていたことを思い出させたり、経験に基づく提案を返し、判断をサポートする存在へ近づく。記憶や認知をAIと共有し、判断をサポートされる未来が、CES2026のステージで提案されていた。

■ヘルスケアはAI駆動の「ロンジェビティ(長寿化)」へ

記憶や認知がAIに支えられる未来が見え始める中、私たちの「肉体」もまたAIによって24時間守られる時代が近づいている。

今回のCES2026では、単なる測定を超えて、本人が気づかない変化をAIが先回りして捉え、アドバイスを行い、健康寿命を延ばす「ロンジェビティ(長寿化)」を日常の中で実現するテクノロジーが目立った。

鍵は、努力なしに高度なデータが取れ、活用できる“生活に溶け込んだデザイン”である。

体重計が「長寿ステーション」に変わる:Withings「Body Scan 2」

Withingsの「Body Scan 2」は、日常的に使う体重計を、家庭で気軽に心血管や代謝などを横断的に把握し、将来を見据えた管理を目指すデバイスとして紹介されていた。象徴的なのが、血圧測定カフを使わずに高血圧リスクを捉えようとするアプローチだ。

単発の測定ではなく、日々の計測データをAIが解析し「血圧が上がりやすい体の状態か」という傾向を示す。加えて、ハンドルを握ることでPWV(血液が血管の中をどれくらいの速さで進むか)を測り、血管のしなやかさから「血管年齢」を提示してくれる。

さらにBIS(生体電気インピーダンス分光法)では、体内に微弱な電気を通すことで筋肉量や脂肪量の計測だけでなく、細胞のコンディションまで測定してくれる。細胞がどれだけきちんと代謝をしているのかを見極め、身体の元気さを内側から測ってくれるのだ。

そして本質は測定して終わりではない。

データはアプリ上でAI解析され、「ヘルス・トラジェクトリー(健康軌道)」として提示される。今の生活習慣を続けた場合、将来どのようになりやすいか、という方向性を示し、行動を見直す目安になるのだ。有料サービス「Withings+」を通して具体的な改善へのアドバイスまで受けられることも長寿につながっていくのだろう。日常的に使う体重計を、健康変化を先回りで捉える「拠点」に変える、それがBody Scan 2が提示した日常に溶け込むデザインだった。

「下着」が24時間、体調の変化を見守る:Myant「Skiin」

同じく「生活に溶け込む」形で医療レベルのデータ取得を狙うのが、Myantのスマート下着「Skiin」だ。CES2025では衣服をセンサー化し、長時間・連続でデータが取れる可能性が話題になったが、CES2026では一歩進み、集めたデータをどう解釈し、医療やケアにつなげるかという“使われ方”に踏み込んでいた。

Skiinは下着の生地に布状電極を組み込み、装着する小型送信機「Pod」を介して心電図(ECG)を継続取得する。心電図に加え、呼吸、皮膚温、活動量など複数の指標を組み合わせ、AIが体調の変化を“流れ”として捉える点が強調されていた。

各指標単独では見過ごされがちな変化も、複数が重なると「崩れ始めの兆し」として立ち上がる。本人が自覚する前に可視化し、行動判断の材料にする、という設計である。

さらに注意が必要な変化が出た場合は、遠隔モニタリングと連携し、医療者や看護師による確認・相談につなげることも想定されている。

Myantが示したのは「測れる下着」ではなく、毎日身に着ける下着を入口に、変化の早期把握から、医療ケア接続までを視野に入れた健康管理の形だった。

病後の対処をAIが最適化する「パーソナル・メディカル・ツイン」

これまで述べたような予防だけでなく、病後の不安に焦点を当てた展示もあった。韓国のPredictive AI社が示した医療支援プラットフォーム「Dr. Twin AI」は、体調を崩したときに多くの人が悩む「どの診療科に行くべきか」「薬は自分に合うのか」という判断の難しさに対し、遺伝子情報を手がかりに“考えるべきポイント”を整理する支援を狙う。

中核にあるのが「パーソナル・メディカル・ツイン」という考え方で、ユーザーのDNAデータをもとに体質の傾向をデジタル上に再現し、医師に相談する前の段階で「体質に合わない薬」や「今の体調から考えられるリスク」など確認すべき論点を見える化する。診断や治療をAIが代替するのではなく、「迷い」を減らし、医師との対話を具体化する補助線として機能する点に特徴がある。Predictive AI社が掲げる「Right Drug, First Time(最初から正しい薬を)」という言葉は、医師による最初の診断において “より良い判断のための整理役”として位置づけていることを示していた。

■心は表情豊かなAIバーチャルヒューマンに癒される

身体の健康は、このようにAIで支えられる未来が見えてきた。では精神面はどう支えられるのだろうか。CES2026では、AIがまるで人間のように表情豊かに実装され、生活者に寄り添う方向も見え始めていた。

言葉と表情が連動するリアリティを実現する「P3 Labs」

2025年7月にメディア環境研究所が「愛着AI」を提唱した前後から、人格を持つAIがバーチャルヒューマンとして登場し、スマホアプリなどを通じて交流できるようになった。筆者もいくつか試したが、ある程度の時間使うと、もどかしさが募ってくる。

そう、「いつも同じような表情」なのである。

喜怒哀楽の抑揚も単調で、結局は同じ反応の繰り返しに感じてしまう。これでは飽きてしまう。そう思っていた昨今、CES2026の会場で出会ったのが米国スタートアップ「P3 Labs」だった。

P3 Labsが展示していたのは、音声入力からリアルタイムで表情豊かなアニメーションやジェスチャーを生成するインタラクティブ・デジタルヒューマンである。彼らが追究しているのは精巧なビジュアルそのものではなく「言葉と感情の同期」だという。ユーザーの声のトーンや文脈から感情を推測し、その感情に応じた表情を自然に出力する。さらに、対話において“間”のズレが生む違和感を抑えるため、音声から表情生成までのプロセスを低遅延化し、言葉と表情がほぼ同時に連動する体験を目指している。

筆者は会場でレオナルド・ダ・ヴィンチの3Dアバターと会話をしてみた。

英語が得意でない私が言葉に詰まると、急かすことなく穏やかな表情で次の言葉を待ってくれる。「あなたは空を飛んだことがあるんですよね?」と冗談を言うと、笑いながら「それはないよ」と返してくる。その瞬間、私は情報の処理装置と向き合っているのではなく、一人の「聞き手」に受け入れられているような感覚を覚えた。

P3 Labsはこの技術を、スポーツ選手のアバターとファンの交流、博物館での偉人との対話、故人の声やストーリーを保存し次世代が会話できる試みなど、感情を伴うコミュニケーション領域に向けて提供する構想があるという。会場では3D投影ボックスによる等身大展示だったが、スマホやPCでも使うことはできる。

今後、人間さながらの言葉と感情を伴う表情を持つAIバーチャルヒューマンを身近に置き、日々交流し、心の安定や充実を求める人々も出てくるかもしれない。

AIが「心に寄り添う」存在へと変化する兆候がますます見えてきたCES2026だった。

■始まるAIプロダクトの「使われやすさ」競争

さてここまでCES2026での取材したプロダクトを通じて、人々が今後どのようにAIを使い、頼るようになるのかその実装の在り方を紹介してきた。

生活ではヒューマノイドが家庭に入り、家事労働の負担は減少。AIスマートグラスで言語を超えた交流や視野に入るものの理解は加速。記録デバイスで認知・記憶の負担は軽減され、自身のデジタルツインに判断もサポートされていく。健康では、医療レベルの健康データを気軽に取得できるデバイスで病気を予防し、的確な医療アドバイスで長寿化に結び付ける。そして心は自分の感情や言葉の機微を読み取り、共感してくれるAIアバターによって支えられる。そんな未来の生活が見えてきたのではないだろうか?

負担やストレス、孤独感は減り、幸福度を上げやすい社会。それは、もはや空想ではなく「技術的には可能」という前提にいま立とうとしている。

この近未来の中で企業は何をするべきなのだろうか?

後編ではそのことについて考えてみたい。

・ メ環研はCES2026をどう見たか?【前編】はこちら

・メ環研はCES2026をどう見たか?【後編】はこちら

※掲載している情報/見解、研究員や執筆者の所属/経歴/肩書などは掲載当時のものです。