「車内エンタメはいずれ独自の進化を遂げる」 チューリング・青木俊介さんが描くAI×自動運転が変える未来

博報堂 メディア環境研究所では、AIが社会や産業、メディアにもたらす影響について研究・洞察するプロジェクト「AI×メディアの未来」を立ち上げました。その一環として、さまざまな分野で活躍している有識者にインタビューを重ねています。

自動運転技術とAIの進化が加速する中で、注目を集めている自動運転スタートアップがチューリング株式会社です。2021年8月に創業した同社は、カメラ映像のみを使ったEnd-to-End(E2E)自動運転システムを開発中です。

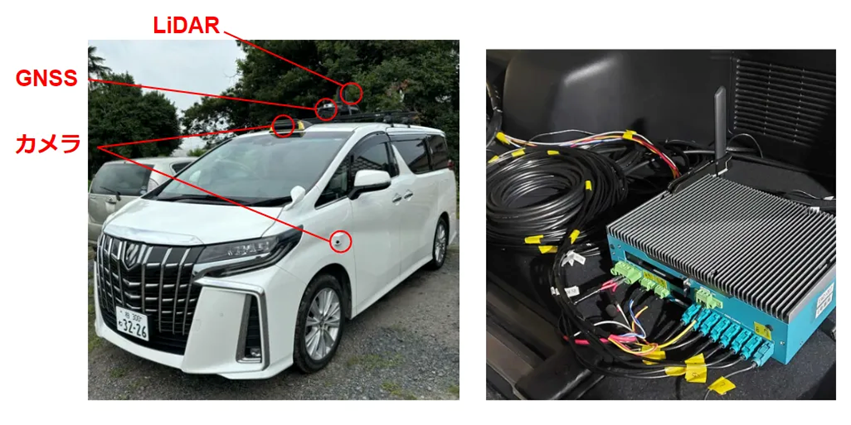

従来の光による測距技術「LiDAR(ライダー)」や高精度地図に頼らず、カメラ映像をもとにステアリング、アクセル、ブレーキといった運転のすべてをAIが判断する仕組みの実現を目指しています。

その中心にあるのが、完全自動運転を目指すAIモデル「TD-1」。カメラ映像を入力し、周囲の標準解像度地図や車両・歩行者の認識、運転操作までを単一のTransformerモデルで処理する最先端の技術です。

今回は、チューリング株式会社 共同創業者・青木俊介さんにインタビュー。自動運転の未来や、AI技術の可能性について伺いました。

生成AIこそが「レベル5=完全自動運転」を現実に

――2024年10月に、チューリングが開発する自動運転AI「TD-1」の走行試験が始まりました。現在はどんな状況ですか?

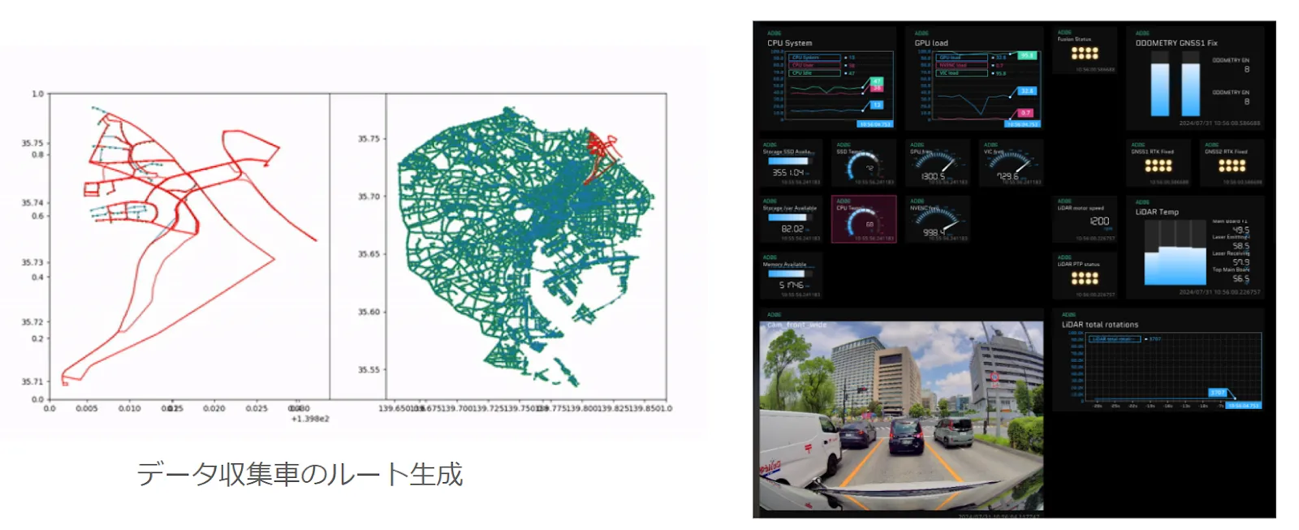

最初はテストコースでしたが、今は街中での試験走行も進めています。データ収集車両は1日に4~10台、テスト車両1~2台が都内全域で走行中です。

ただし、AIがどこまで正しく運転できるか、まだ完全な予測はできません。そのため、プロのテストドライバーがいつでもハンドルを取れる状態で検証を進めています。

――走行時は、どのような技術を使っているのでしょうか? これまでは、カメラとレーザー光を使って周囲の物体までの距離を測定し、3Dマップを生成する技術「LiDAR(ライダー)」を使用するケースもあったと思います。

「LiDAR」はデータ収集時の認識精度チェックに活用していますね。ただ、走行時に使っているのはカメラのみで、基本的にはAIが画像を解析して運転しています。

自動運転には0~5のレベルがあり、数字が小さいほど、人の関与が必要です。この中で、私たちが目指しているのは、一番上のレベル5。呼んだら車が来てどこへでも行ける、AIだけでの完全自動運転です。

従来のレベル4の自動運転は「LiDAR」で作成した地図を頼りに走行するという仕組みでした。でも、地図の作成・更新コストがかかり、街の変化に対応しづらい。ルールベースの自動運転は決められたルールの範囲でしか動けないため、道路工事や突発的な障害物には対応できません。だから、約10年経った今でも商用化が進んでいないんです。

でも、AIなら状況を見て判断することができるのではないか、と考えて。だから、私たちは「エンドツーエンドAI(※)」に完全にシフトすると決めたんです。最初の試作では、カメラ1台と小さなニューラルネットワークで、前方の画像をもとにハンドルやアクセルを操作するシステムを作りました。

(※)人工知能(AI)にデータの入力から出力までのすべてのプロセスを、単一の機械学習モデルに委ねるアプローチのこと。「E2E AI」とも呼ばれる。

創業当時は「AIだけで運転?」という反応も多かったですね。ですが、ちょうど将棋や囲碁でAIが人間に勝ちはじめ、「運転もAIでいけるのでは?」という議論が少しずつ出ていました。

――現在、AIによる自動運転技術はどこまで進んでいるのでしょうか?

自動運転AIも、文章や画像の生成AIと同じように進化しています。「ChatGPT」が言語を扱えるように、自動運転AIも画像解析だけで運転できる時代になりつつあるんです。例えば、AIが映像を見て「この交差点は交通量が多いので。作業員の指示に従ってください」といった運転アドバイスを文章で説明できるようになっています。

また、従来のシミュレーターでは、車と車、車と人のリアルなインタラクションを正確に再現できませんでした。例えば、ゲームではキャラクター同士がぶつかると動けなくなることがありますが、現実の車はそうはできないですよね。

そこで、AIが映像データをもとに未来を予測する自動運転向け「生成的世界モデル・Terra」を開発しました。

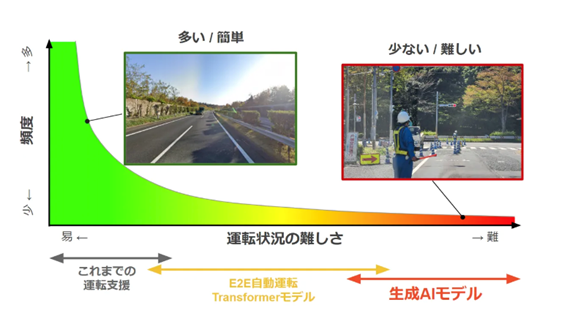

運転も、いわゆるロングテール現象が起こるんですよね。つまり、白線があるだけのシンプルな道のような「よくある運転パターン」の予測は簡単。

でも、信号や交通誘導員がいる工事現場などの「たまに発生する複雑なシチュエーション」がすごく難しい。これがルールベースの自動運転だと突破できないんですよ。ですが、AIが「次に何が起こるか?」を予測すれば、より人間に近い運転判断ができるようになります。

また、AIが人間の運転の意図をデータ化することも重要です。そこで、「この歩行者がこっちを見ていなかったから減速したんだ」など、意思決定のデータを蓄積し、AIの判断力を向上させています。

自動運転車には「リラックス効果」がある?

――現在、自動運転では物体認識に加え、それとは独立した事象の判断が行われていますよね。将来的には、こうした処理がさらにリアルタイムで進化するイメージでしょうか?

そうですね。例えば、自然言語処理の分野を例に挙げると、かつてはDeepLやGoogle翻訳が主流でしたが、今ではほとんどの人がChatGPTのような大規模な生成AIを使っています。これは、翻訳だけに特化したAIよりも、幅広い知識を持ったAIの方が、結果的に翻訳精度も向上するからです。

自動運転も同じで、特定の機能だけを99.99%まで極めるより、広範な知識を持つAIが全体の認識精度を高める可能性があります。

――私たちが運転するときは「車も自分の体の一部」と捉えている節があり、身体性も大きく関わっている印象があります。その前提に立ったとき、車線や人物、車両などの認識に関わるデータだけではなく、例えば、街路樹の枝葉が揺れているから横風が吹いている、雨上がりだから路面が滑るかも、早朝は高齢の歩行者が多いから速度を遅くした方が安全など、もっと広範な情報や知識を取り入れる必要があるのではないかと感じました。

現在も、ウェブ上の情報も取り入れてデータ収集をしています。「GPT-4」など、大規模言語モデルを開発している企業と同じ手法で文章や画像データを学習させる形です。

しかし、「車の運転においてどこまでのデータが必要なのか?」については、まだ明確な答えが出ていません。特に、「運転に関わる身体的な感覚をどのようにAIに学習させるのか」「現在のデータだけで十分なのか」という点は課題です。

人間も、免許が取れる年齢になる18歳まで、いろんな経験を積み重ねていますよね。そして、教習所に通ってルールや車の動きを学んで、運転できるようになる。何万時間も通ったから運転できるわけではありません。だから、実は教習所に通う以前の18年間に何を学んできたかが大事ですよね。

――ちなみに、自動運転車と人が運転する車で、実際の乗り心地に違いはありますか?

私自身、特に印象的だったのはリラックス効果を感じたことでした。弊社のCEOやファンドの担当者を含めた4人で30分ほど自動運転車に乗ったんですが、最初は「すごい!」と興奮しました。

けれど、途中から空気が変わり、自然と本音を話す雰囲気になったんです。自然とお互いの胸襟を開いて話せる、リラックスしたコミュニケーションの場が生まれていたんですよね。これは新幹線に乗ると本を読みたくなったり、飛行機で仕事がはかどったりするのと同じ効果なのかもしれません。

距離は近いけれど、向き合っているわけではない。いわゆる銭湯に入る時やゴルフカートの中にいる感覚に近いのでしょうか。お互いの素が見える新しい体験でとても面白かったです。

自動運転の普及には、技術以外の「壁」が存在する

――自動運転車が世の中に普及するには、あとどのくらいの時間がかかりそうですか?

車の開発は、企画段階を含めると約7~8年がかかります。なので、量産化にはまだ時間が必要です。ただ、技術面では完全自動運転の実現自体はそんなに先の未来ではないと思います。

――日本においてAIの実装・普及を強く推進できる有力な手段の一つが自動運転車ではないかと感じるのですが、いかがでしょうか?

体験すると広がるという意味で自動運転車にはそのインパクトがあると思います。自分専用で、足を伸ばして好きなところに連れて行ってくれる。

上場企業の社長が集まる場で講演する機会があったのですが、実際に「ChatGPT」を触ったことがある経営者が少ないのは一つの問題です。特に地方では、直感的にAIへの抵抗感がある人が多い印象です。

そして、AIを一部活用した事業はあっても、経済的なインパクトをしっかり生み出す産業にまでは発展していませんよね。日本から世界に向けて展開されたソフトウェアで目立っているのはゲーム。ゲーム機というハードウェアに乗せることで、何度も世界市場に進出しています。

一方で、スマホアプリ分野は、なかなか厳しい。世界的なアプリはほとんど英語圏の企業から生まれている。

そう考えると、日本国内でソフトウェアを開発する意味は一定あるものの、最終的に海外展開を視野に入れる場合、プラットフォームを持つことが非常に強みになるのではないかと考えています。

――特に地方において、車は日本の少子高齢化という課題を解決するための優れたインターフェースになると思いますが、いかがでしょうか?

実際、私たちの会社にも「自動運転技術を地方で導入できないか?」といった問い合わせがよく来ます。ただ、現状ではコストとの兼ね合いもありまだ本格的な導入には至っていないのが実情です。

地方創生の観点から「自動運転バスを導入したい」という声は多く聞きます。しかし、バス運営自体が赤字であることが多く、税金や福祉の予算で補填されてなんとか成り立っている。そこにスタートアップ企業が参入しようとしても、そもそも資金が足りない企業同士だと、実現が難しいんですよね。

――なるほど。普及していく際の課題点として、ほかにはどんなことがありそうですか?

車の運転に関して、男女間で頻度の違いがあることがわかっています。郊外ではあまり差はないのですが、都市部では男性のほうが運転をしているんです。そして、「家族で旅行するときに行き先を決める」などの意思決定も男性に偏っているケースが多い。

しかし、運転が自動化されれば、今まではあまり運転をしていなかった女性も自由に家族をどこかへ連れて行けるようになる。技術の発展によって、男性が履いていた「見えない下駄」が脱がされる要素も少なからずありそうだなと思いました。

――完全自動運転(レベル5)は実用化される場合、最初は高価格帯の車から導入が始まり、最終的にはバスなどの大衆向け交通機関に広がるという流れになりそうでしょうか?

本当は「すぐに多くの人に広まる」と言いたいところですが、まずは裕福な層から導入されるのが一般的です。例えば、カラーテレビや洗濯機も、最初はお金に余裕がある家庭から普及していきました。自動運転も同じ流れになるのではないでしょうか。

ただ、バスは別の進化を遂げる可能性があります。決められたルートを走るバスは自動化しやすい一方で、私道や駐車場の出入りといった細かい運転が難しいという違いがありますから。

自動運転がもたらす未来——変わる価値観と新たなライフスタイル

――自動運転が本格的に普及すれば、単に運転の負担が減るだけでなく、それこそ「移動するエンタメ空間」としてコンテンツのあり方も大きく変わりそうです。

車が新しいプラットフォームとなり、車内向けの新しい専門アプリが登場するのではないかと考えています。今はスマホのアプリが車で使えたり、車内でNetflixが見られたりする程度ですが、いずれは独自進化を遂げるのではないでしょうか。

iPhoneが登場したとき、有識者でも「結婚相手を探すのにスマホアプリが主流になる」とは想像できていなかったはずです。けれど、世の中は大きく変わった。車の中も、今では想像もつかない形で発展する可能性が高いと考えています。

――自動運転車によって人の身体的な状態や感情の動きが分析できれば、“体験”そのものを提供する広告が可能になります。ある場所に行くことで購買につながる体験型広告のような、新しいビジネスモデルの可能性も生まれそうです。

技術の使い道が明確だと、議論が進みやすいんです。自動運転は「安全に走行させる」「新しい移動体験を作る」といった明確な目的や制限がある。逆にそこから新しい広告体験を発想しやすいのかもしれませんね。

また、不動産価値基準も変わる可能性があります。例えば、「駅から近い物件が高く評価される」から、「自動運転車を活用しやすい場所」「幹線道路の近く」などにシフトして、首都高の入り口が近い場所や自動運転車用の駐車場が整備されたエリアの価値が上がるかもしれません。

さらに、通勤時間の概念も変化すると思います。「運転しなくても快適に移動できるなら、30分くらいの通勤時間はむしろリラックスできていい」と考える人も増えるかもしれませんし、車を「第二の家」のように使う人も出てくるでしょうね。

――最後に、今後の展望についてぜひ教えてください。

自動運転は技術的な進化と社会的な意義を兼ね備えた非常に重要なテーマだと捉えており、会社を立ち上げた以上、責任を持ってやり抜かなければと考えています。

今、アメリカではすでに自動運転が普及しはじめていて、運転しなくても快適な生活を送っている人がいる一方、日本人は頑張って運転しつづけている……。このギャップがすごく心に引っかかるんですよね。

日本では。よく「完全自動運転車って意味あるの?」などと言われていました。でも、アメリカに行ったときは一度もそんな質問をされなかったんです。それだけ、すでに多くの人が必要性を感じている技術なのだと実感しました。だからこそ、日本でも実現させたいと感じています。

2025年2月10日インタビュー実施

聞き手:メディア環境研究所 冨永直基+所外協働プロジェクトメンバー 鵜飼大幹、花光宣尚

編集協力:矢内あや+有限会社ノオト

※掲載している情報/見解、研究員や執筆者の所属/経歴/肩書などは掲載当時のものです。